AI会否取代人类的工作?会……

我向某银行职员投诉说频频收到垃圾简讯,对方又再敷衍 。我有气,威胁说若再不停止,就向国家银行投诉。为了表示我不是说空话,打算立刻草拟投诉信给他看。写这种公函我是老大不愿意,浪费我的才华和时间(笑),但我更讨厌垃圾简讯;正要下笔之际,想起ChatGPT。

ChatGPT是最近当红的人工智能聊天机器人。我对它说:“帮我写封信向国家银行投诉某银行滥发垃圾简讯。”不消几秒钟,它给我起草了头头是道的公函,甚至“自动自发”地引述马来西亚2010年个人资料保护法案。我一字不改,因为没有需要修改的地方,直接用这封信“恐吓”银行职员。

过去二十年来,在我工作上从未有过一个人类同事能写得出就叫我满意的公函或文案,更别说一字不改,就算简单的佳节贺语也会有疏漏。今年,我婉转地叫他们甭自己写了,用ChatGPT,我预期将会少吐几碗血。

我大学时上了几堂人工智能课,二十几年前的事了,当年我们还在谈“图灵测试”:当你无法分辨网路彼端和你用文字聊天的究竟是人还是机器时,就表示AI已达人类智能的水平。那时候,通过图灵测试听起来是多么遥不可及的事。

然而去年图灵测试便已成历史名词,因为谷歌的LaMDA聊天机器人,居然能让其工程师布萊克·勒莫因误以为它已变成有感知、有情感、有思想的“生命”。LaMDA不公开,因此我无缘体验,直到ChatGPT出现,我才深深感受到它有多神奇,和某程度上有多可怕。

LaMDA和ChatGPT的原理类似,利用人工神经网络(neural network)模拟人脑操作,通过大量“训练”让它“学会”用怎样的输出来回应用户输入。这些聊天机器人阅览网上海量文章,形成字词的排列模式;人类研究员给机器人的回答打分,让它“知道”怎样的回答才算恰当。

也就是说,机器人是完全不懂自己在说什么,只知道you之后写are出错的机率最低、针对你的提问大多数人用哪些文字回答,都在靠猜。但这“猜”的背后有庞大资料和语言模式支持,恐怕超过我一百辈子的阅读量,无怪乎能写出许多人写不出来的文章。

它能做什么呢?写信只是其一,凡和文字相关的工作都能帮上忙,比如撰写广告文案。但人工智慧本身是没有创意的,只能根据资料吐出最可能相关的回答。早在ChatGPT走红以前就出现了文案撰写机器人,马来西亚资深广告人哈曼达星对它嗤之以鼻:“如果商家的文案是要写给机器看而不是给人读,那么尽管使用人工智能吧!”可是,所谓创意未必是创作出全新的东西,更多时候是发现事物之间的关联和组合,人工智能的语言模式那么庞大,就算不能写出合格的文案,至少也是个不错的脑力激荡伙伴。

聊天机器人还能回答一般问题、写程式代码、帮你做文章摘要等等,目前最具争议的课题是学生用它来做功课。虽说人工智能目前还未能取代诸如程式员、秘书、编辑等的工作,但多少已能看出发展趋势,在技术变得更成熟以后它将能胜任许多基础工作。假如你是一个只交行货的文案撰写员,人工智慧将可以交出比你更好的行货,毕竟它的阅读量比你多一百辈子。

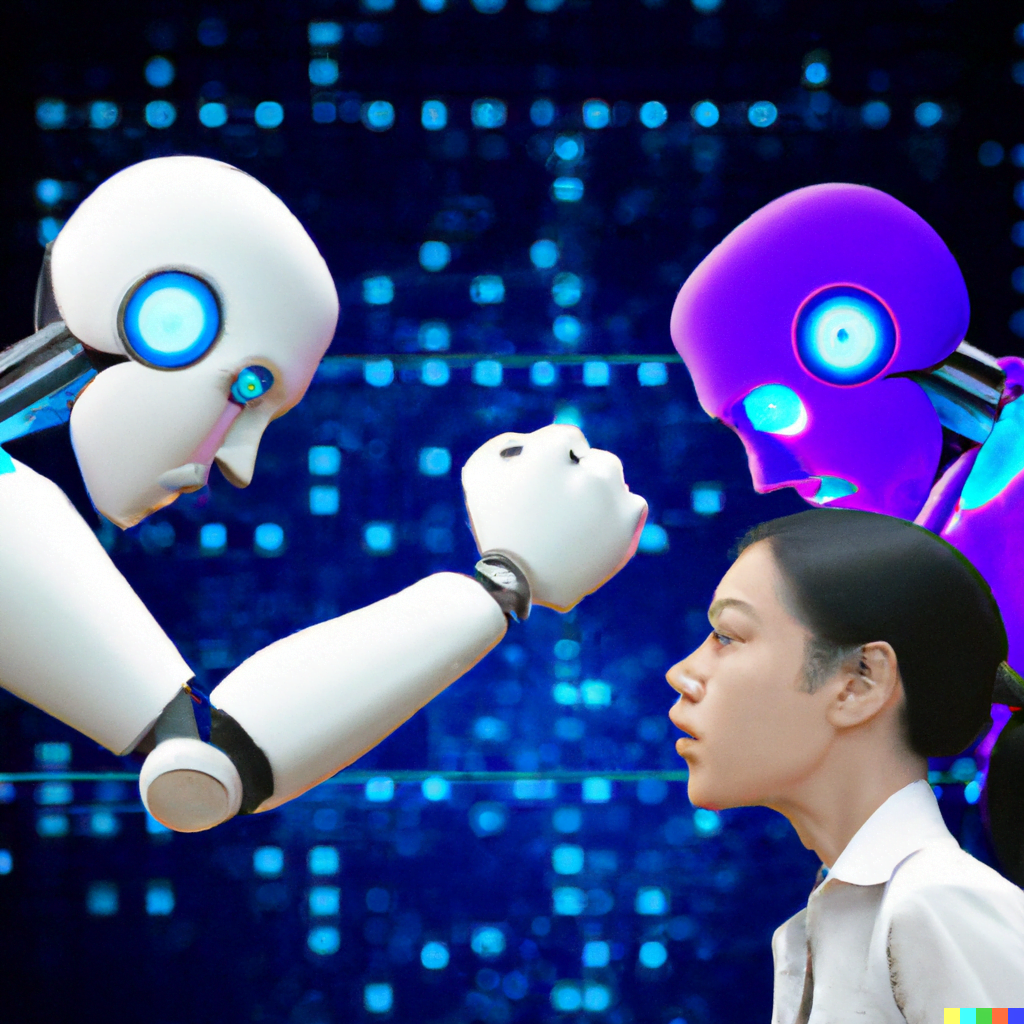

ChatGPT还有另一姐妹项目叫DALL-E,用人工智慧按照文字指示生成插画,也叫我叹为观止。首先它的人工神经网路必须明白字词之间的关系,比如说“两个个胖子在广场用脚持刀”,要人类想象这场景不难,但神经网路必须先学懂胖子是什么模样、刀长什么模样,还要知道刀和脚之间的关系,以及明白广场是背景,再组成一幅图。以上例子DALL-E不止画给我了,还知道该画菜刀。虽说品质一般,但用于一般网路文章配图绰绰有余,未来多少插画师的工作会因此丢了?

下一波发展是把人工智能用到影视上。早在2020年,韩国MBN电视台以真人主播金柱夏为原型,创造了几可乱真的虚拟主播。人工智能从金柱夏过去的录影“学”会她的神态和语音,便可根据剧本制作新闻播报片段。如今这技术已不只是电视台才有资源运用,有一位商家不喜欢上镜,但又必须借TikTok等平台宣传,他委托AI公司生成他演说的视频。我看了那段视频,说话举手投足像真人一样,若不是预先告知我,我不会知道那是人工智能的杰作。电视主播、主持人的工作,还稳当吗?

接下来的研究方向是让人工智能根据文字叙述产生视频,跟它说“猫狗互相追逐,绊倒了老人家”,一段视频就做好了。这听起来遥不可及,但当年通过图灵测试听起来也遥不可及,也许在十年内连制作影片的工作也要让电脑取代,无需导演、场务、演员、灯光师、茶水……只要人工智能掌握足够数据,就可撰写格式化的剧本,然后复制周润发的表演、吴宇森的风格。这听起来匪夷所思,然而ChatGPT在三十年前听来也一样匪夷所思。

人工智能会取代人类的工作,但不是全部,它没有情感,不通人性,尽管能模拟情感和人性,但很难超越预设的资料局限,像ChatGPT目前资料仅到2021年为止,之后的事完全不知。人工智能是可以主动学习的,但它没有价值观,不会判断对错,2016年微软其实曾经推出过聊天机器人Tay,它在一天之内在推特中学坏,变成了极端种族和性别歧视者,微软被逼中止它。ChatGPT不能在没有人类研究员的监督下自主学习,不然就会被“污染”。

我们似乎已逼近科技的另一临界点,人工智能将带来另一波社会变革,就像工业革命那样。过去人们担心机器会取代人类的工作,实际上只是改变了工作内容,人类改做机器无法胜任的思考工作。当电脑连基本思考也能做到,那么人类就必须自我提升,利用人工智能作辅助工具,担当电脑无法胜任的、更高层次的创意工作,如此才能在下一波变革中站得住脚。

2023.03刊于当代评论

又:文首插图由DALL-E提供,我的文字指示是:Artificial intelligence beating up human